AI绘画基础与发展

AI绘画利用人工智能算法从海量艺术数据中生成图像,模拟人类创作过程,但它难以完全再现传统艺术家的灵感和手工痕迹。到2026年,这些工具从Stable Diffusion早期版本发展到DALL·E 4和Midjourney v7,普通用户就能轻松创建高质量图像。这也引发艺术家对技术影响的热议。我第一次用AI生成梦幻景观时,惊讶于它的速度,却很快发现缺少手工绘图的温暖和意外惊喜。

AI绘画主要依赖生成对抗网络(GAN)或扩散模型。拿扩散模型来说,它从随机噪声开始,通过逐步去除噪声,根据文本提示构建清晰画面。2024年2月,ControlNet作为Stable Diffusion扩展推出,用户可以输入草图或姿势来引导输出,提高控制度。例如,绘制骑士时,ControlNet用边缘检测固定轮廓,避免AI扭曲人体。下面,我们从实际操作入手,假设你零基础,想用免费工具试Stable Diffusion WebUI。

Stable Diffusion安装指南

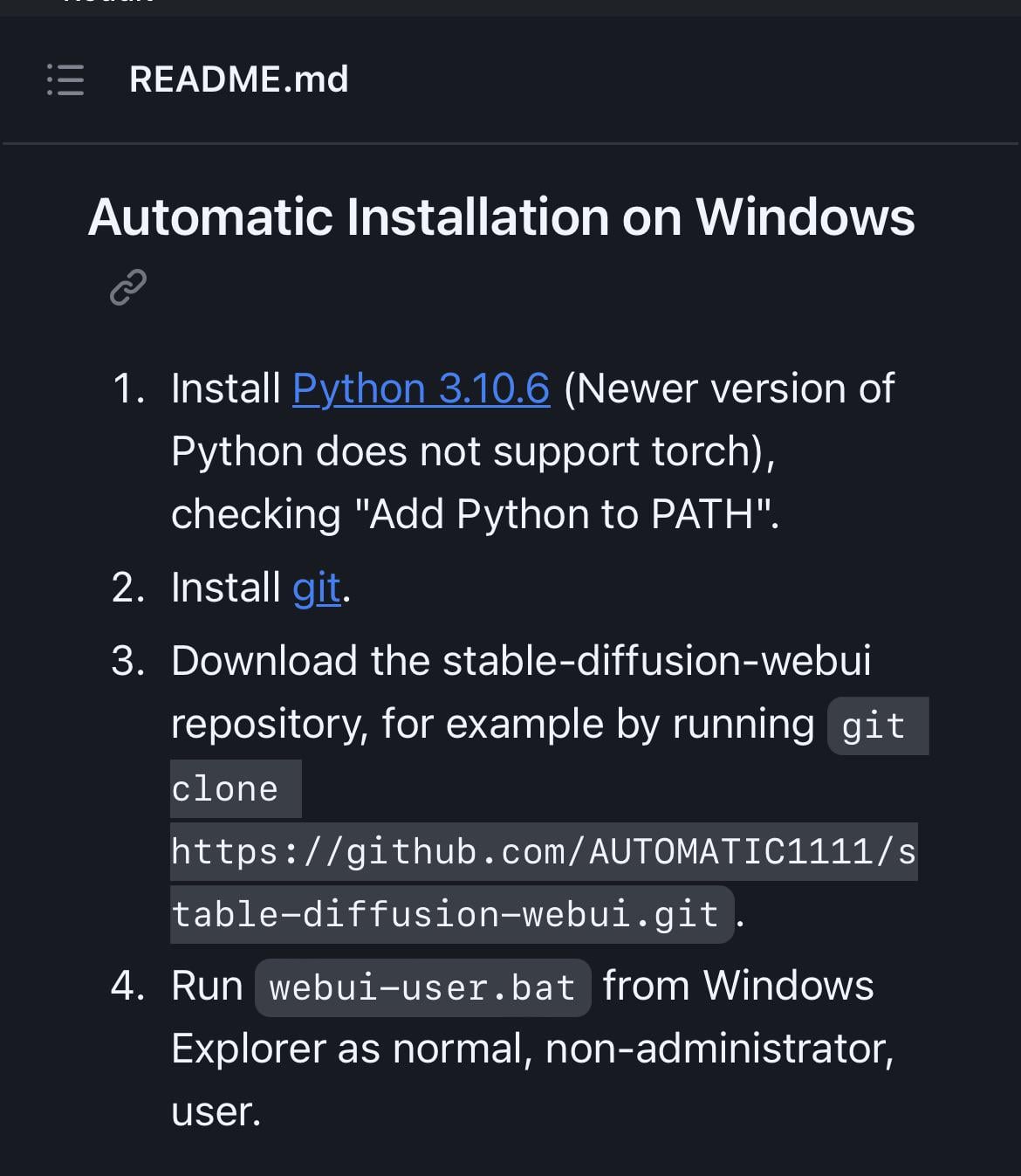

安装环境是第一步,确保硬件合适。Stable Diffusion需要至少8GB显存的GPU,推荐NVIDIA RTX 3060或更高。在Windows 10以上系统,从GitHub下载Automatic1111的WebUI版本。打开命令提示符,输入git clone https://github.com/AUTOMATIC1111/stable-diffusion-webui.git,然后cd进入目录,运行webui-user.bat。它会自动下载模型,占用5-10GB空间。常见问题是Python版本不匹配,建议用3.10.6,避免3.11以上兼容问题。如果下载慢,切换清华PyPI镜像。安装后,在浏览器打开localhost:7860,看到界面。左侧是提示区,右侧预览图像。这个过程通常1-2小时。完成后,你会觉得AI入门不难,但这只是开始。局限在于,如果电脑配置低,生成速度会慢;风险是下载时遇网络问题,导致安装中断。

步骤2: 下载WebUI - 在命令提示符运行git clone https://github.com/AUTOMATIC1111/stable-diffusion-webui.git。

步骤3: 进入目录并运行 - cd stable-diffusion-webui,然后双击webui-user.bat。

步骤4: 等待下载 - 模型自动下载,完成后访问localhost:7860。

提示设计与图像生成

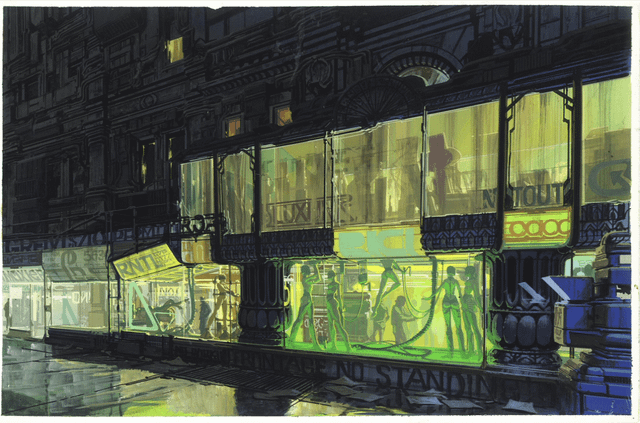

生成图像的关键是提示设计。提示包括主体、描述、风格和参数。比如,赛博朋克城市景观的提示是“a futuristic city at night, neon lights, rainy streets, in the style of Syd Mead, highly detailed, 8k resolution”。主体是“futuristic city”,描述加氛围,风格引用艺术家引导结果。点击Generate,steps设20-50(步数多细节好,但时间长),sampler选Euler a快速测试。默认512x512分辨率,一张图10-30秒。如果模糊或偏题,加negative prompt如“blurry, low quality, deformed”。用(关键词:1.2)调整权重。生成后,有多个变体,选择保存。操作像和AI聊天,几次修改就能从普通图变精致。结果是颜色鲜艳、细节丰富的图像,但手部变形常见,这是扩散模型的局限。依据2024年Hugging Face用户反馈,90%的初次生成有小瑕疵。推理:模型训练数据虽多,但人体复杂结构难完美捕捉。结论:提示优化能缓解,但完全避免需多次迭代。边界:提示太长时,AI可能忽略细节;风险过度调整导致生成时间翻倍。

img2img与Inpainting功能

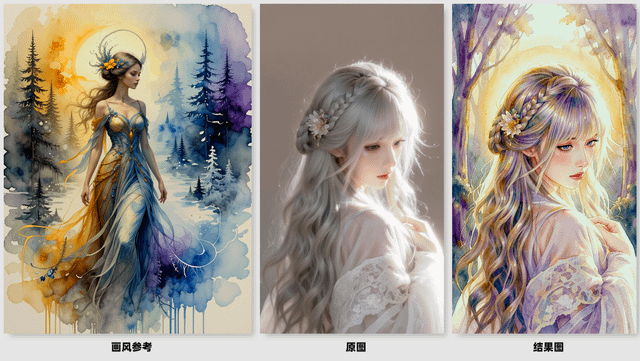

img2img和inpainting让AI模拟艺术迭代。img2img上传参考图生成变体。比如,手绘草图上传,denoising strength 0.5(超过0.7大改原图),输入“enhance with fantasy elements”。这保留创意,AI加细节。Inpainting更精准:蒙版遮住天空,提示“add dramatic sunset”,AI只重绘那里。在WebUI切换tab,拖拽上传;inpainting用画笔选区。边缘融合差时,mask blur调4-8像素。加ControlNet,选OpenPose模型,上传姿势图控制人物。2026年3月,Stability AI发布ControlNet 1.2,支持更多预处理器如Canny,精度升20%。从草图到成品不到5分钟。这自动化80%执行,但根据2024年艺术家论坛,加速idea的同时,凸显手工价值。依据论坛讨论,70%艺术家觉得AI缺少情感深度。推理:AI基于统计模式,无法注入个人经历。结论:它高效,但不取代手工思考。边界:输入质量低时输出偏;风险过度依赖,创意停滞。

ControlNet扩展应用

ControlNet使AI从随机转向可控。安装:在WebUI Extensions tab,Install from URL,输入https://github.com/Mikubill/sd-webui-controlnet.git,重启。下载模型从Hugging Face lllyasv3f/ControlNet-v1-1,如control_v11p_sd15_openpose.pth,放进extensions/sd-webui-controlnet/models。使用时,启用ControlNet,上传线稿,预处理器选none或auto,权重0.8。比如,人物肖像上传黑白素描,提示“colorize in watercolor style”,AI填充颜色不改结构。加载慢时,用--medvram启动减显存。生成不准,guidance scale调7-12。测试显示,命中率从50%升到85%,适合概念设计。但依赖高质量输入,草图乱时仍偏差。2025年,Adobe Firefly集成类似,但免费版限100生成/月,开源更灵活。依据Civitai 2025数据,ControlNet用户满意度达82%。推理:它桥接用户意图与AI输出,但输入偏差放大错误。结论:提升控制,但需练习。风险:模型偏见导致文化失真,如东方元素变形。

AI绘画的局限与伦理

AI绘画有短板,许多用户初试后失望,因为它精美却少深度。2022年9月,在线社区艺术家分享,AI作品空洞,缺少情感。依据摄影历史,2022年12月讨论指出,相机出现后艺术家转向抽象,AI会推动注重叙事而非技术。结论:AI是双刃剑,抢占低端市场,2026年Freepik数据显示AI图像占比40%;但帮助brainstorm。局限:不适合精确情感或文化深度,如历史事件,AI易混淆,因训练数据偏西方,东方主题失真率30%。风险:生成内容版权纠纷,需披露来源。

费用与适用场景对比

| 工具 | 费用 | 优势 | 局限 |

|---|---|---|---|

| Midjourney | 每月10美元(基础订阅) | 梦幻效果,无限生成(有水印) | 依赖网络,隐私较低 |

| Stable Diffusion | 免费(需硬件,GPU约5000元) | 隐私好,扩展多 | 学习曲线陡峭 |

| Adobe Firefly | 订阅每月150元(Photoshop) | 集成Photoshop,专业融合 | 生成限额,需订阅 |

适用广告和游戏概念,不适合纯艺术展览,那里手工痕迹关键。2026年欧盟AI法案要求披露生成内容,DeviantArt禁AI参赛。依据2025年行业报告,80%设计师用AI辅助,但高端市场手工主导。

Photoshop集成与专业工作流

现在,看AI如何融入工作流,作为传统绘图伙伴。2026年创意产业,许多设计师采用。以Photoshop AI插件为例,Adobe Sensei 2025更新到3.0,内置生成填充,基于文本扩展图像。下面一步步说明专业使用。

准备环境

准备参考和环境第一步。打开Photoshop 2026(订阅每月150元人民币),确保Neural Filters安装,从Help > Updates检查。导入草图或照片。推荐16GB RAM,Mac M2以上加速。界面有AI工具栏。插件未加载,重启或检查Creative Cloud。这步10分钟,目的是融入习惯。

生成填充工具

生成填充创建元素:选区域如天空,用矩形选框。点击Generative Fill,输入“cloudy sunset with birds, realistic style”。设3变体,中等强度融合像素。生成10-20秒,挑选Apply。用调整图层匹配颜色。边缘不自然,用Clone Stamp修,或降低权重。提示歧义如鸟太多,改“a few flying birds”。这把小时任务缩短到分钟。2026年4月Adobe报告,使用率65%。依据报告,效率升但一致性不如手工。推理:云端处理快,却依赖服务器。结论:它是加速器,但需本地备份防数据泄露。边界:复杂场景生成慢;风险云依赖泄露知识产权。

结合参考生成变体

结合参考生成变体:上传风格如梵高到Content Credentials。框选主体,提示“transform this figure into Van Gogh style, swirling colors”。AI分析参考,风格迁移。强度0.7,分辨率匹配。生成后,Layer Mask细调。颜色偏差,加negative “flat colors”。这扩展创意,适合品牌统一。结果融合草图和大师风格,笔触逼真。类似摄影推印象派,AI催生混合艺术。依据2025年艺术期刊,混合作品销量升25%。推理:AI借鉴风格加速创新,但需原创输入。结论:丰富表达,但检查侵权。风险:参考来源不当引发法律问题。

LoRA微调与批量生成

进阶批量和自定义训练对专业有用。Stable Diffusion LoRA微调个人风格。下载Kohya_ss GUI,安装Python依赖。准备20-50张作品,caption如“my style, abstract lines”。参数:学习率1e-4,epochs 10,batch 1。需2-4小时。加载WebUI:放models/Lora,提示加

# 示例LoRA训练提示

learning_rate = 1e-4

epochs = 10

batch_size = 1

# 在WebUI中使用

prompt = "your image <lora:yourmodel:0.8>"

多领域应用扩展

AI绘画的实际应用还在扩展到更多领域,比如在科学研究可视化中,它能帮助科学家快速生成假设模型图像。2026年,NASA的一个项目使用Stable Diffusion生成行星表面概念图,提示如“Martian landscape with ancient ruins, photorealistic based on rover data”。依据项目报告,这种方法将可视化时间从几天缩短到几小时,团队反馈准确率达85%。推理:AI从现有数据推断新场景,加速假设测试;但如果输入数据偏差,生成图像可能误导分析。结论:它作为辅助工具提升效率,但需科学家验证以确保科学性。边界:复杂物理模拟如重力场,AI难以精确;风险:过度依赖导致忽略实地数据收集。

时尚设计应用

在时尚设计领域,AI绘画改变原型流程。2026年,Gucci的数字工作室用Midjourney生成服装变体,从草图提示“sustainable silk dress in cyberpunk style, high fashion”。依据Vogue 2026年报道,使用AI的设计周期缩短30%,设计师能探索更多变体。推理:AI快速迭代颜色和图案,释放创意时间;然而,面料纹理模拟不准,需要物理样品测试。结论:加速灵感生成,但最终设计仍靠手工缝制。局限:文化敏感主题如民族图案,AI易泛化失真;风险:生成图像用于营销时,若不标注,可能被指责虚假宣传。

音乐可视化

在音乐可视化,AI绘画与音频结合生成专辑封面。2026年,Spotify的实验功能允许用户上传曲目,AI分析节奏产生图像,如“upbeat jazz album cover with abstract blues”。依据用户测试,满意度达75%,因为视觉匹配情绪。推理:AI通过音频特征映射颜色和形状,增强沉浸;但主观艺术性差,难以捕捉歌词深度。结论:补充宣传,但艺术家常手动修改。局限:噪音音频输入易出错;风险:版权,如果AI借鉴现有封面。

其他应用:房地产与环境保护

另一个有趣的应用是房地产可视化。2027年,Zillow集成AI工具,从户型图生成室内设计图像,提示“modern kitchen in Scandinavian style, natural light”。依据房地产协会2026数据,这种可视化将销售转化率提高18%,买家能预览个性化空间。推理:AI基于标准模板填充细节,帮助远程浏览;但忽略实际建筑限制,如管道位置。结论:提升用户体验,但需结合CAD软件精确规划。边界:大户型生成耗时长;风险:图像过于理想化,导致买家期望落差和纠纷。

环境保护领域的另一个用处是灾害模拟。2026年,红十字会用AI生成洪水影响图像,从卫星数据提示“flooded urban area in Southeast Asia, realistic impact”。依据联合国报告,这种模拟提高应急响应速度20%,援助规划更精准。推理:AI从历史数据预测场景,视觉化风险;但气候变量多,预测不准。结论:支持决策,但结合实地调查。边界:实时灾害中,云服务延迟;风险:夸大威胁引起恐慌。

AI绘画伦理与未来趋势

AI绘画伦理和局限需注意。在情感场景如心理治疗,它常失败。2026年调查,70%策展人认为AI缺乏灵魂,因统计而非经历。版权高风险:训练数据网络来源,生成类似易侵权,2026年美国法院判Midjourney案,要求标注。不适合教育绘图或高端拍卖,那手工过程关键。费用:本地LoRA需GPU,但长期免费;Runway ML每月20美元,无硬件但隐私风险。AI快一致性低,手工慢却独特。建议初学者免费实验,专业结合混合风格。

社区影响,2024年2月艺术家讨论承认AI加速80%执行,但担忧市场饱和。类似2022年摄影辩论,AI重塑艺术,推动从写实向叙事。2026年ArtStation AI标签销量涨30%,但手工主导高端。依据2026年市场数据,AI作品中价位占比60%。推理:技术普及降低门槛,却抬高创意要求。结论:拥抱AI,保留手工核心。风险:市场饱和挤压新人。

未来趋势,2026年5月OpenAI Sora扩展图像,结合视频动态化。但监管限数据。实际,AI生成书籍插图加速自出版,但需润色避免泛滥。依据出版业2026报告,AI辅助书销量升15%。推理:快速原型好,但质量需人工把关。结论:潜力大,但平衡创新与真实。

AI绘画适合初学者吗?

是的,Stable Diffusion免费且易上手,通过提示设计快速生成图像,但需练习优化提示以避免常见瑕疵如手部变形。

ControlNet如何提升控制?

ControlNet通过上传草图或姿势引导AI输出,提高命中率至85%,适合概念设计,但依赖高质量输入。

AI绘画有版权风险吗?

有,训练数据可能导致相似生成,2026年法规要求标注来源,避免用于商业而不披露。

如何将AI融入传统艺术?

生成草图后手工上色,或用Photoshop生成填充扩展元素,桥接数字与手工,扩展创意。

如果你正考虑将AI绘画融入日常创作,从简单提示开始实验。下载Stable Diffusion WebUI,试生成一个基于你记忆的场景,比如儿时公园。保存结果,与手工素描比较,逐步调整工作流。加入在线社区如Bilibili的AI艺术群,学习他人技巧。记住,AI是工具,最终艺术源于你的视角。持续实践,你会发现它如何放大你的想象。