AI 视频生成是通过扩散模型或 Transformer 架构将文本、图像转化为动态视觉内容的生成式人工智能技术。目前,该技术已从生成简单的短片段,演变为能够处理复杂物理规律、维持长时序一致性的生产力工具。

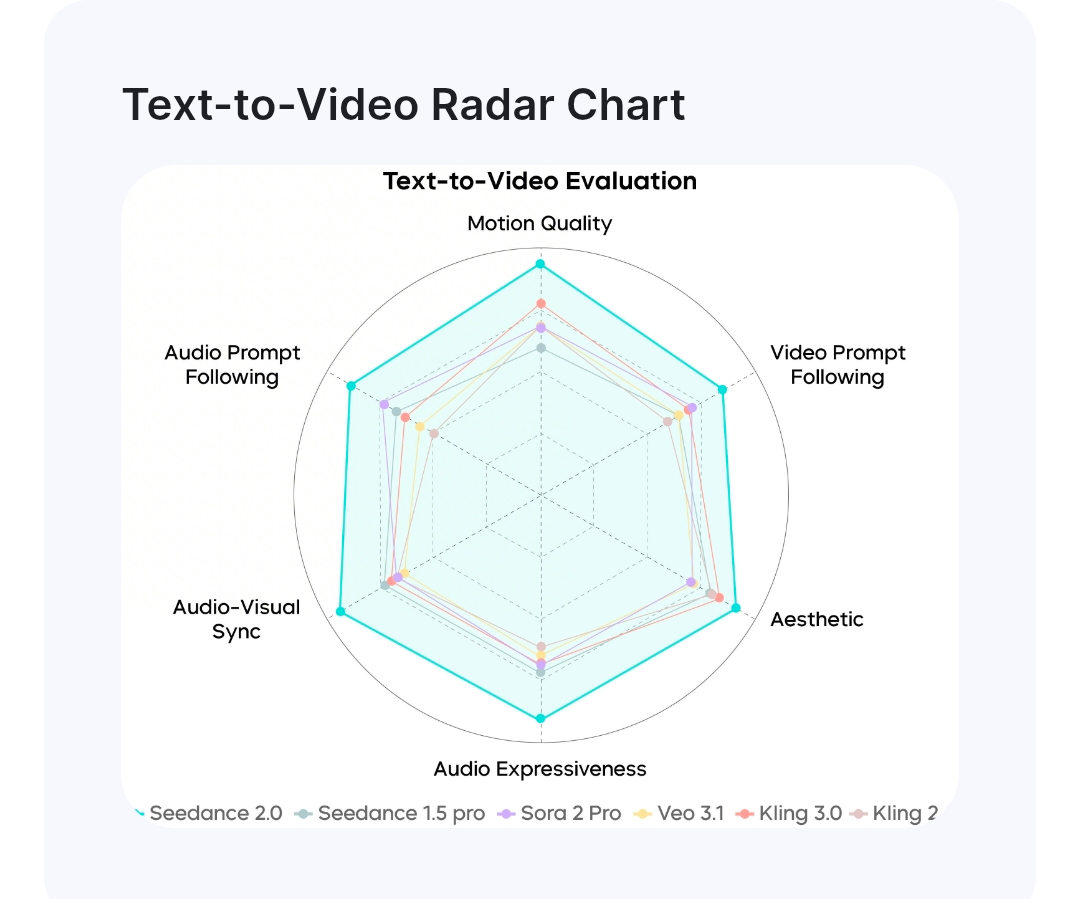

到 2026 年 3 月,行业竞争焦点已从追求像素真实度,转向可控性、物理模拟精度以及商业版权的法律界定。Sora 2、Kling 2.6 和 Wan 2.6 等主流模型在很大程度上解决了液体流动、重力感和物体遮挡等底层物理逻辑。但由于在应对极端精确的品牌视觉要求时仍存在随机性,AI 尚未完全取代专业摄影师。

技术演进:从潜空间扩散到时空注意力机制

当前顶级模型普遍采用 DiT(Diffusion Transformer)架构,将视频帧视为类似 GPT 处理文字的 Token(标记),而非早期卷积神经网络的局部像素处理方式。

在这种机制下,模型在潜空间(Latent Space)中学习视频的时空表征。输入提示词后,模型首先在低维潜空间生成噪声分布,再通过去噪过程,利用时空注意力机制(Spatio-Temporal Attention)锁定物体特征。例如,确保第 1 帧的红苹果在第 100 帧中不变成红色圆球。2.6 版本模型通过增加时间维度的注意力权重,使 60 秒内的背景不再漂移,人物服装细节得以稳定。

商业短片实操:从原图到成片的工业链路

对于电商卖家或营销人员,直接输入文本生成视频往往不可控。高效的商业路径是:原产品图 → AI 视频模型 → 局部重绘/编辑 → 剪辑合成。以 Creatify 为例,其核心逻辑是基于 URL 自动化拉取素材,但高质量产出需经过深度干预。

第一步:素材准备与结构化提示词

参数配置上,Motion(运动幅度)建议设定在 3-5 之间。数值过高易导致物体形变,过低则接近静态图。目标是获得 5-10 秒且产品无畸变的 B-roll 素材。

第二步:局部修正与去接缝

为避免修改区域与原视频出现接缝,需微调重绘强度(Denoising Strength),将其控制在 0.3-0.5 之间,使新生成内容自然融入背景,确保产品还原度达 100%。

第三步:节奏对齐与音效掩盖

主流工具能力对比

| 维度 | Sora 2 | Kling 2.6 | Wan 2.6 |

|---|---|---|---|

| 视觉真实度 | 极致电影感/大场景领先 | 人体肌肉/皮肤质感极强 | 均衡,偶有光影跳变 |

| 可控性 | 较低(依赖提示词) | 较高 | 中等 |

| 成本与速度 | 高成本/速度慢 | 中等 | 低成本/速度极快 |

| 适用场景 | 商业大片 | 快速电商素材 |

常见问题哪个AI视频生成模型在视觉真实度上最领先?Sora 2 在复杂光影和大场景的电影感上处于领先地位,而 Kling 2.6 在人体肌肉运动和皮肤质感方面表现更强。

怎么提高AI生成商业视频的可控性与产品还原度?应采用结构化提示词并上传高分辨率产品细节图,同时利用局部重绘功能将去噪强度控制在0.3-0.5之间以消除接缝。

AI视频生成目前存在哪些核心局限?核心短板包括训练集版权界定模糊、长时序物理崩溃(超过3分钟易出现物体消失)以及缺乏深度情感的微表情。

参考来源想体验 HAPPY 图片生成?立即免费试用 → |